5月14日,尊龙z6人生就是博首页OpenAI联合创始人、首席科学家伊尔亚 苏茨克维(Ilya Sutskever)宣布离职,几小时后,超级对齐团队负责人杨 莱克(Jan Leike)也宣布离职。

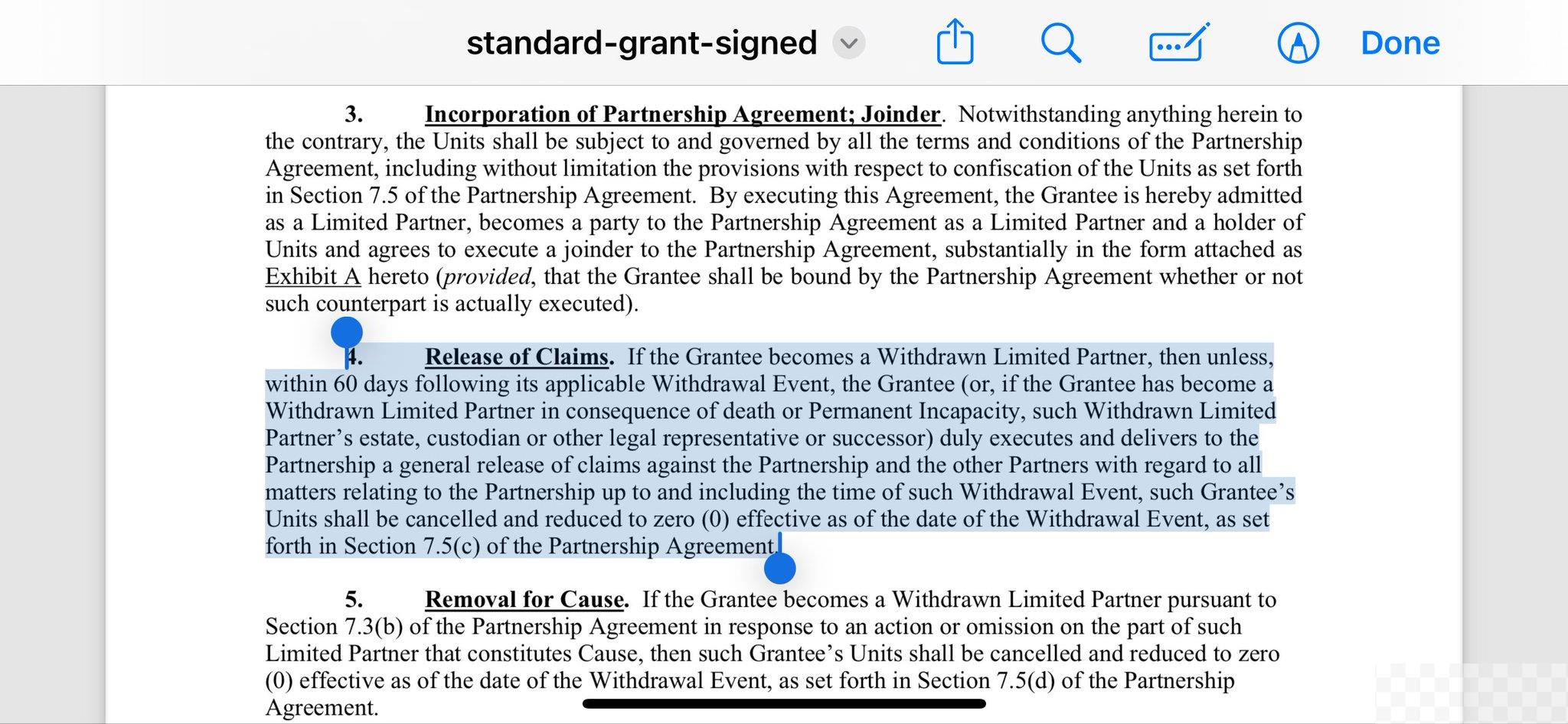

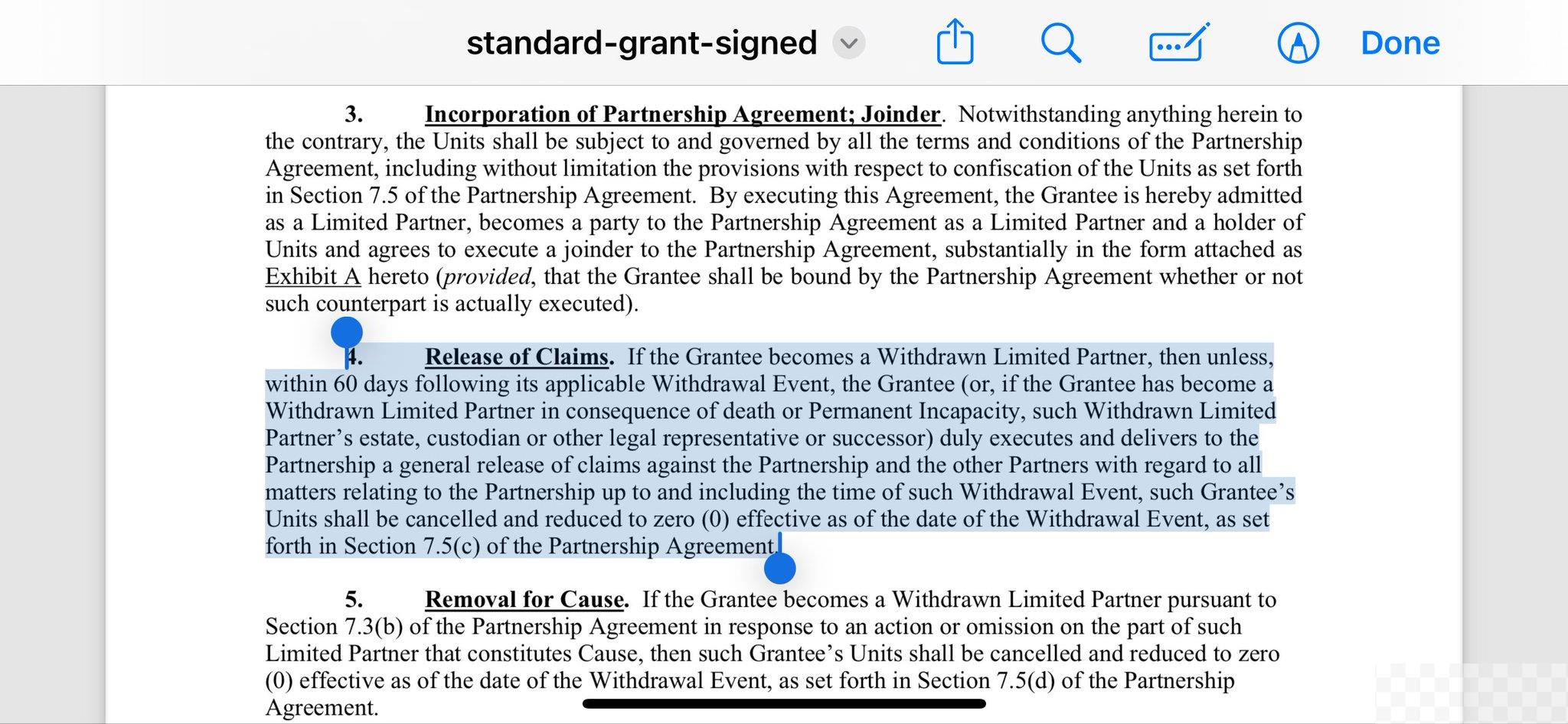

同时,OpenAI也被曝出让员工在离职时签署带有 不贬损承诺 的离职协议,如果拒绝签署就得放弃公司股权。

奥特曼回应称: 我们从未收回任何人的既得权益,如果人们不签署协议(或不同意不贬损协议),我们也不会这样做。既得权益就是既得权益。

封口协议 之外,安全相关人员的相继离开,引发人们的更大担忧。OpenAI的超级对齐团队主要任务是对研发的AI进行评估并监督,防止AI走向失控局面。

他强调: OpenAI必须成为一家安全第一的AGI(通用人工智能)公司 辞去这份工作是我做过最困难的事之一,因为我们迫切需要弄清楚如何引导和控制比我们聪明得多的人工智能系统。然而,我与OpenAI领导层在公司的核心优先事项上存在分歧已有一段时间,直到我们最终达到了临界点。

杨 莱克的推文

马斯克也在莱克的推文下回复称: 安全问题在OpenAl并不是重中之重。

文中提到: 我们还不确定何时会达到发布的安全标准,如果这会推迟发布时间表也没关系 我们将继续针对不同的时间范围进行安全研究。我们还将继续与政府和许多利益相关者就安全问题展开合作。

此前的2023年底,奥特曼曾被OpenAI董事会解雇。据外媒报道称,导火索是几名研究人员致信警告称一项强大的AI(人工智能)发现可能威胁到人类。不过在700多名员工威胁辞职以及微软公司等多方压力下,奥特曼很快便重返OpenAI担任CEO,并组建了新董事会。

OpenAI在Q*上取得的进展,让部分公司内部人士相信,这可能是他们找到 超级智能(即AGI) 的突破。OpenAI将AGI定义为 比人类更聪明的AI系统 。